Stell dir vor, du startest an deinem Fernseher ein Spiel, aus der Cloud, in 4k/120fps, superscharf und ohne Verbindungsprobleme. Dieses Spiel nennen wir UNREAL WORLD. Dieses Spiel wird ein massives Open World Game, das alles zuvor dagewesene in den Schatten stellt. Du betrittst dabei eine Anfangswelt ähnlich einem Social Hub, das erstmal für alle gleich ist, dennoch vom Entwickler in Windeseile, mit neuesten Technologien prozedural generiert wurde.

Du klickst auf »Spiel starten« und wirst in eine Open World entlassen. Es ist der Anfang eines story-driven Action-RPGs mit fotorealistischer Grafik, die nicht mehr von der Realität zu unterscheiden ist. Alle Quests werden von einer KI genau in dem Moment generiert und geschrieben, inkl. deren Charaktere und dessen Gesichtsanimationen, die aus einer Bibliothek von Mimiken und Gestiken stammen und per KI so zusammengefügt werden, dass keine Animation der anderen gleicht, es dennoch völlig realistisch und glaubwürdig aussieht.

Dabei wird das Voiceover ebenfalls täuschend echt in Echtzeit generiert werden und das trainiert von 100.000ten von Stimmen. Dabei wirst du nicht merken, dass die Stimmen unecht sind, genauso wenig, dass die Dialoge, je nachdem was für eine Quest du startest, völlig individuell verlaufen und du durch eine Funktion den NPC sogar Fragen stellen kannst, die er aufgrund seiner Backstory und grundlegenden Geschichte dir beantwortet.

In dem Game wird es einen unendlichen Nachschub an richtig gut geschriebenen Quests geben. Die Open World wird dabei – wie fast alles – prozedural generiert sein, was dir als Spieler nicht mehr auffallen wird, da es wie handgebaut wirkt. Sämtliche Töne wie Vögel, Wasser, Wetter, Autos, Lärm, etc. werden in Echtzeit erschaffen. Du wirst Quests erleben, die zuvor noch niemand spielte. Es werden random Ereignisse stattfinden, und kein Entwickler wird es jemals kommen sehen, welche Quests in dem Spiel noch auftauchen. Sie legen höchstens Parameter fest, um illegale oder sensible Inhalte auszuklammern. Du kannst diese dann für andere Spieler verfügbar machen. Willkommen in UNREAL WORLD.

Ich gebe zu, das, was du eben gelesen hast, ist arg auf die Spitze getrieben und nach aktuellem Stand rein unmöglich. Aber wenn wir 10 bis 20 Jahre vorausschauen und die aktuellen Entwicklungen betrachten, den KIs, Grafik-Engine´s und viele andere Technologien, die dazu gehören, machen, sehe ich das als relativ realistisch an. Aber wie soll das alles funktionieren?

KI macht Unmögliches möglich

Was aktuell im Bereich der künstlichen Intelligenz passiert, ist schier der reinste Wahnsinn! ChatGPT hat den riesigen Hype losgetreten und viele Software-Giganten ziehen nun nach. Da sehe ich ein Bing Chat, was ein völlig neues Sucherlebnis dir bietet, KI-gestützte Soundgeneratoren, die dir auf Anweisung sogar ganze Musikstücke schreiben und generieren. Bildgeneratoren, deren Ergebnisse einfach nur überwältigend sind. Und Google selbst arbeitet ebenfalls eifrig an der Verbesserung von Gemini. Wie du sicherlich vorhin gemerkt hast, habe ich auch in meinem aktuell utopischen Spiel viel davon gesprochen, dass vieles »generiert« wird. Das werden aber KI-Tools in Zukunft alles leisten können und das wird auch in zukünftigen Spielen vieles aufs nächste Level hieven.

Ultrarealistische Gesichter

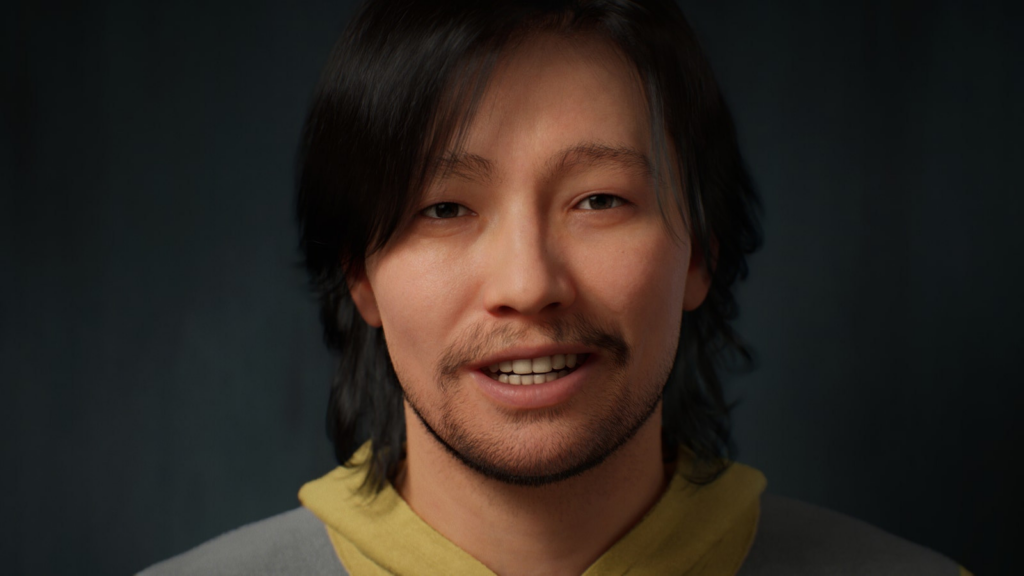

Epic Games hat neulich bei der State of Unreal wieder neue Fortschritte in der Entwicklung von Technologien für der Unreal Engine 5 und deren neuen Tools vorgestellt. Und die waren schlicht mindblowing. Wir werden in Zukunft Spiele sehen, die ultrarealistisch animierte Gesichter zeigen, wo du zweimal hinschauen musst, ob dies eine Real-Aufnahme ist, oder ein 3D animiertes Gesicht. Das Zauberwort heißt hierbei MetaHuman.

Mit diesem Tool können in Windeseile fotorealistische Gesichter erstellt werden und bei der State of Unreal, wurde der MetaHuman Animator vorgestellt. Mit dem ist es möglich, Gesichter, die per Handy aufgezeichnet wurden, direkt in MetaHuman zu importieren, daraus ein 3D Modell zu erstellen und die aufgenommene Mimik direkt auf das digitale Abbild zu übertragen. Das wurde auch direkt bei der State of Unreal demonstriert.

Diese Technologie werdet ihr übrigens bald im kommenden Hellblade 2: Senua’s Saga in voller Pracht bewundern können. Den der Titel setzt voll auf die neuesten Technologien der Unreal Engine 5 und sieht jetzt schon fantastisch aus. Auch hier gab es dazu eine passende Demo:

Prozedurale Generierung auf einem neuen Level

Es ist nicht so, dass es prozedurale Generierung in Spielen noch nicht gibt. Ein Spiel wie No Mans Sky wäre ohne diese Technologie schlicht unmöglich. Doch bisher hatte diese Technik so ihre Tücken, auch wenn sie Level-Designern und vor allem Teams, die eine Open World schufen, so die grundlegende Arbeit etwas erleichterten. Das Ding war aber immer, man hat es dem Endprodukt angesehen, wenn es prozedural generiert wurde. Ein Paradebeispiel hierfür ist No Mans Sky. Dessen Planeten am Ende irgendwie alle ein wenig gleich aussahen und irgendwie auch langweilig. Handgebaut, schaffte halt Highlights, die im Kopf blieben. Mittlerweile ist aber No Mans Sky, mit vielen kostenlosen Updates ein richtig gutes Spiel geworden. Wir wollen das ja nicht total schlecht reden.

Epic Games will dieses Problem, das alles gleich und auch ein wenig generisch aussieht, nun angehen und stellte eine Technologie vor, in der Gelände diverser Größen eben prozedural generiert werden kann. Aber so, dass man es dem Gelände später nicht ansieht und es Team ermöglicht riesige und interessante Welten in kürzerer Zeit zu erschaffen. Es ist schlicht beeindruckend, wie in der Demo einzelne Level-Parts bewegt werden und ein Algorithmus diese „sinnvoll“ wieder zusammensetzt. Zudem wurde eine Technologie vorgestellt, die sich Substrate nennt und realistischere Texturen bzw. Schichten von Texturen ermöglicht. Was ultrarealistische Oberflächen ermöglicht.

Quests von einer KI

Kommen wir zum nächsten Part, dem Content im Spiel an sich. Gehe auf die Seite von OpenAI, oder von mir aus Bing Chat und gebe dort ein, dass die KI dir eine kurze Geschichte schreiben soll. Details kannst du ihr noch sagen, aber im Groben und Ganzen wird sie los rattern und dir eine kleine Geschichte schreiben. Zugegeben, manchmal generieren diese KIs noch Mist und manchmal ergeben diese generierten Geschichten auch wenig Sinn. Aber bedenke! Wir sind hier noch ganz am Anfang dessen, was in einigen Jahre möglich sein wird.

Nun stell dir vor, die KIs sind so weit, dass diese nachvollziehbare und gut geschriebene Quests generieren können. Mit diversen Handlungsabläufen, mehreren Charakteren und den heißgeliebten Story-Twists. Und das ganze, um mein utopisches Szenario vom Anfang aufzugreifen, in Echtzeit.

In 10 bis 20 Jahren…

Wir erleben gerade einen massiven Sprung nach vorne, was viele Technologien im Gaming-Bereich betrifft. Wir sind ganz klar noch am Anfang, aber auch schon verdammt weit. Der Fortschritt wird dahingehend rasant sein. Wenn ich jetzt an die Kombination von KI-Tools denke, die Bildbearbeitung beherrschen, Content erstellen, Sounds und VoiceOvers dazu generieren, eventuell noch den passenden Soundtrack in diesem Moment erschaffen und Dialoge generieren, mit der passenden hyperrealistischen Grafik. Sprich Unreal Engine 6 mit weit fortgeschrittenen KI-Generatoren, dann wirkt mein utopisches Szenario, gar nicht mehr so utopisch.

Funfact: Das Artikelbild von Senua aus Hellblade 2, wurde ebenfalls mit KI hochskaliert, geschärft, neu beleuchtet und nachbearbeitet 😉